Mọi công ty hiện tại đều có một nhân vật như thế này.

Một lập trình viên kỳ cựu, một ông quản lý cấp trung, hoặc một giám đốc xắn tay áo lên, mở Claude Code, và giải quyết lượng công việc của cả tuần chỉ trong một buổi chiều. Mọi người nhìn anh ta với ánh mắt ngưỡng mộ xen lẫn hoảng sợ. Sếp lớn vỗ vai ngợi khen. Hồi xưa mình cũng từng có giai đoạn y hệt vậy lúc mới vọc vạch AI — thấy mình như siêu nhân, ngáo quyền lực kinh khủng vì gõ phím nhanh gấp mười lần cả phòng cộng lại.

Hơn người là sướng. Hơn chính mình hôm qua lại càng sướng. Anh ta nghiễm nhiên trở thành cái cột cờ để công ty đem ra khoe về thành tích “chuyển đổi số” hay “văn hóa AI”.

Nhưng nếu bạn là CEO của Chainguard, một startup về an ninh mạng đang bùng nổ ở Thung lũng Silicon, bạn sẽ gọi anh ta vào phòng và nói thẳng: “Cậu đang làm sai rồi.”

Hết phim.

Thuộc Địa Hóa Bằng AI

Tại sao một người dùng AI xịn nhất, năng suất cao nhất lại bị coi là vấn đề?

Cái kịch bản một cá nhân xuất chúng bỏ lại cả cộng đồng phía sau vốn không hề mới. Bạn không cần mở sách quản lý ra để thấy nó. Bạn chỉ cần giở cuốn tiểu thuyết Nervous Conditions của nhà văn Tsitsi Dangarembga. Trong đó, cô bé Tambu khát khao được đi học để thoát nghèo. Nhưng người chị họ Nyasha của cô (người được đưa đi hưởng một nền giáo dục hoàn chỉnh kiểu Anh) lại hoàn toàn sụp đổ.

Nyasha mất kết nối với cội nguồn, mắc chứng rối loạn ăn uống, rối loạn danh tính và tự hủy hoại bản thân. Nền giáo dục kiểu thực dân trong câu chuyện này không phải là sự giải phóng. Nó là một quá trình trích xuất (extraction): rút những cá nhân xuất sắc nhất ra khỏi cộng đồng, cài cho họ một hệ điều hành mới, và khiến họ không bao giờ có thể quay lại để nói cùng ngôn ngữ với những người ở lại. Họ trở thành những hòn đảo thượng đẳng, cô độc và đứt gãy.

Đó chính xác là những gì đang xảy ra trong các đội ngũ công nghệ lúc này.

Khi một quản lý cấp cao biến thành một “power user” (người dùng AI cắm mặt vào màn hình để tối ưu hóa năng suất cá nhân), họ đang thực hiện một quá trình trích xuất tương tự. Họ lấy đi cơ hội học hỏi, cơ hội mắc sai lầm, và cơ hội cọ xát với công cụ mới của cấp dưới. Họ giải quyết bài toán nhanh hơn gấp mười lần, nhưng họ để lại phía sau một đội ngũ hoàn toàn mù chữ về AI.

Vấn đề của một power user là họ không thể mở rộng quy mô. Một cá nhân xuất chúng không tạo ra một hệ thống xuất chúng. Họ chỉ tạo ra một cái cổ chai có tốc độ xử lý cực cao.

Lưỡi Dao Bách Phân Vị

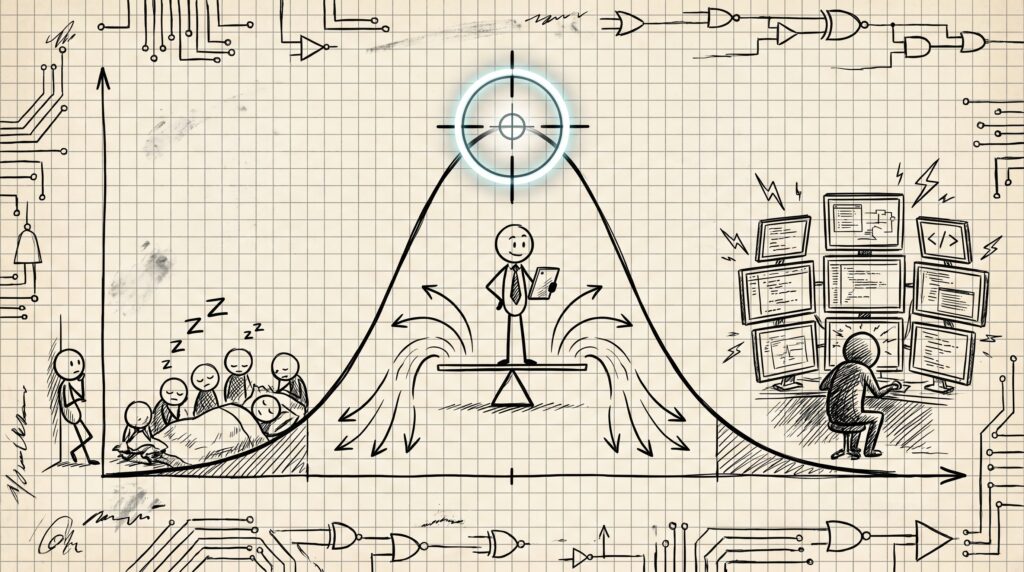

Tháng 4 năm 2026, Dan Lorenc, đồng sáng lập kiêm CEO của Chainguard, đã rò rỉ một quy định nội bộ kỳ lạ. Ông ép các quản lý kỹ thuật của mình phải duy trì lượng token sử dụng AI ở đúng bách phân vị thứ 50 (50th percentile) so với nhân viên dưới quyền.

Quy định này vả thẳng vào kỳ vọng thông thường.

Nếu bạn nằm ở nhóm dưới 50, bạn lười. Bạn đang mất liên lạc với thực tại và chẳng có cái bối cảnh quái nào để đánh giá hay hướng dẫn đội ngũ của mình vượt qua khó khăn. Bạn trở thành kẻ mù dắt người mù.

Nhưng nếu lượng token của bạn vọt lên mức 80 hay 90, bạn cũng ăn đòn. Ở mức đó, bạn đang chơi trò cá nhân. Nhiệm vụ của bạn với tư cách lãnh đạo không phải là tự tay đẩy code cho nhanh. Nhiệm vụ của bạn là phải chia sẻ cái bối cảnh đó ra, làm gia sư, và ép những người đứng chót bảng phải làm quen với việc dùng công cụ.

Chainguard đang ép buộc một hành vi: từ bỏ việc trở thành thần đồng, và bắt đầu làm hệ thống phân luồng. Cùng với hạn mức token, họ ra một quy tắc bổ sung. Mọi tài liệu thiết kế sản phẩm bắt buộc phải có một mục tĩnh: “LLM nói gì về cái này?”.

Cú Lừa Của Hệ Thống

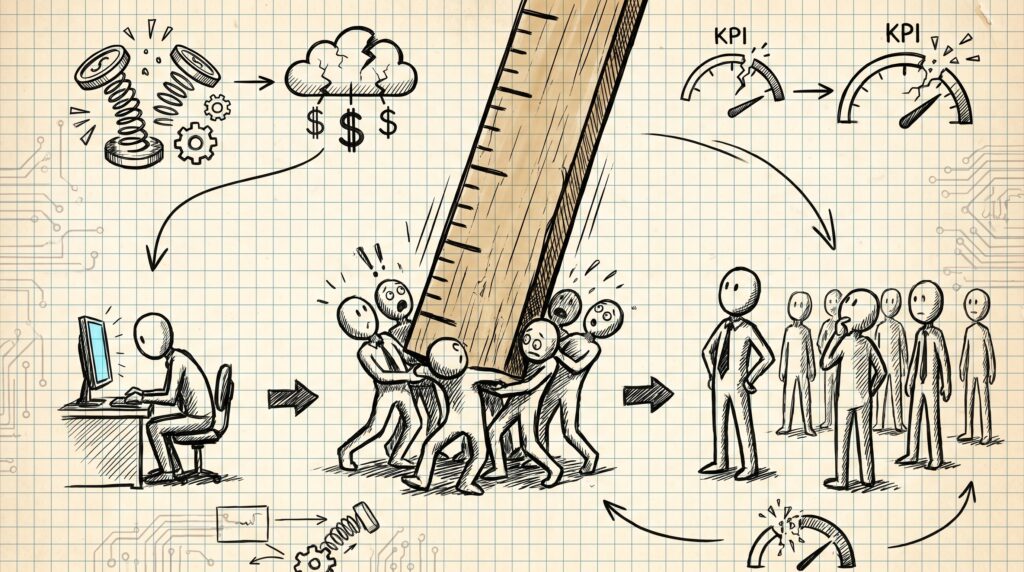

Dĩ nhiên, đo đếm năng lực bằng lượng token là một công cụ cực kỳ cùn.

Dân kỹ thuật là chúa lách luật. Cắm một đoạn script chạy tự động dưới nền để đốt token lấp đầy hạn mức 50% là trò trẻ con. Hơn nữa, nếu chỉ đo bằng số lượng, chúng ta đang cổ xúy cho một thứ văn hóa đốt tiền cloud vô nghĩa chỉ để đạt KPI bề mặt. Một kiến trúc sư phần mềm lỗi lạc có thể dùng chưa tới 1.000 token, nhưng đó là 1.000 token đâm trúng huyệt để gỡ rối một lỗi hệ thống mà năm kỹ sư bên dưới loay hoay suốt một tuần.

Nhưng Dan Lorenc thừa biết thước đo này cùn. Ông vẫn làm.

Vì cái đích của quy định trên không phải là đo lường sự chính xác học thuật. Bản thân luật đó là một sự ép buộc thể chế. Khi tổ chức dí một thước đo định lượng thô bạo lên đầu, thước đo đó buộc bạn phải thay đổi tư thế ngồi. Từ việc dán mắt vào màn hình IDE của riêng mình, người quản lý buộc phải ngẩng lên nhìn xem cả phòng đang đốt bao nhiêu token. Lệnh này lôi AI từ chỗ là một kỹ năng cá nhân mờ ám thành một giao thức tổ chức minh bạch.

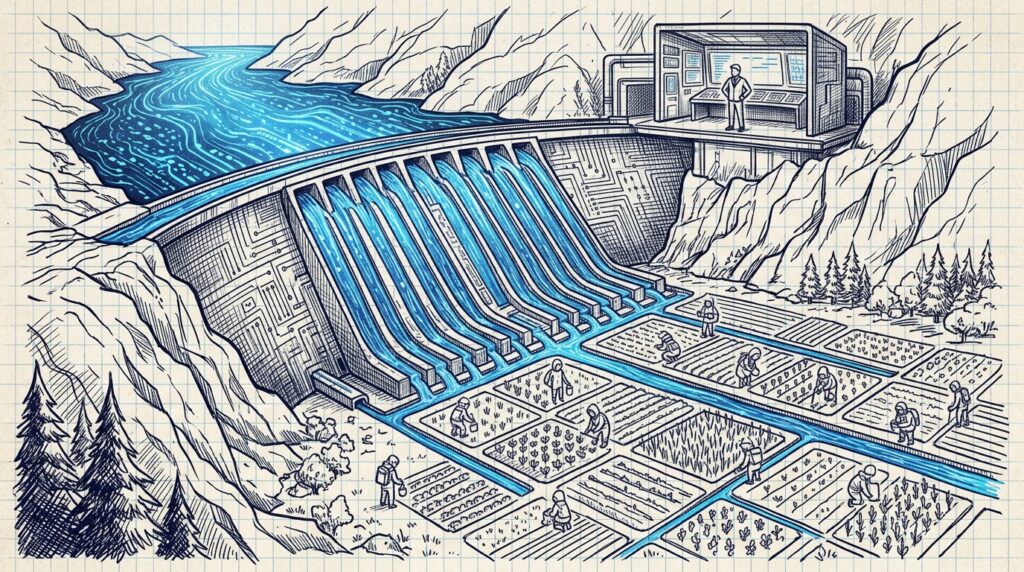

Nước sẽ luôn tìm đến những khe nứt tự nhiên. Năng suất AI cũng vậy, nó sẽ tự động chảy dồn về phía những cá nhân miệt mài cày cuốc ngày đêm. Nhưng nhiệm vụ của người đứng đầu không phải là nhảy vào bơi trong cái vũng nước đó.

Nhiệm vụ của họ là đắp đập.

Hãy tưởng tượng một ngày, bạn mở bảng điều khiển của công ty. Bạn nhìn vào biểu đồ sử dụng AI nội bộ. Bạn không nằm ở top đầu kiêu hãnh, cũng chẳng mài đũng quần ở đáy. Bạn đứng lọt thỏm ở ngay giữa.

Mọi người bên dưới đang đua nhau đặt câu hỏi, tranh cãi với LLM, nhúng AI vào sâu trong các tài liệu chiến lược. Bạn không tự tay đụng vào một dòng code nào hôm nay. Nhưng độ lệch chuẩn về năng suất giữa người xuất sắc nhất và người lười nhất trong đội ngũ đã bị kéo sập xuống.

Lúc đó, bạn mới nhận ra công việc thật sự của người làm quản lý. Không phải là hóa thân thành siêu nhân gánh team như mình từng ảo tưởng.

Công việc đó là thay cả hệ thống đường ống, chứ không phải chỉ nhét thêm cái vòi nước xịn cho vài cá nhân đơn lẻ.