Tuần trước có hai bài viết ra gần như cùng lúc, cách nhau vài ngày, nói về cùng một thứ mà cảm giác như ở hai hành tinh khác nhau.

Bài thứ nhất: Jensen Huang — ông trùm NVIDIA, công ty 4 nghìn tỷ đô xây bằng GPU — ngồi với Lex Fridman trên podcast rồi tuyên bố giật mình: “Tôi nghĩ chúng ta đã đạt được AGI.” Bài thứ hai: ba giáo sư từ Carnegie Mellon và Georgia Tech viết trên Harvard Business Review rằng muốn mở rộng AI agent thành công, cách tiếp cận đúng không phải coi nó như phần mềm — mà phải đối xử với nó như một thành viên trong đội. Gán cho nó danh tính, giới hạn quyền, chỉ định nguồn dữ liệu, kiểm soát hành vi, và ghi lại mọi quyết định.

Một bên nói AGI đã ở đây. Bên kia nói agent chưa đủ trưởng thành để tự đi toilet mà không có người kèm.

Cái khoảng cách đó — nó không phải bug. Nó là bản chất của cuộc chơi lúc này.

Cái định nghĩa co giãn theo người nói

Quay lại câu chuyện Huang. Fridman cho ông một cái thước khá rộng rãi: AGI thực sự sẽ trông như thế nào? Có thể hình dung là một AI tự khởi nghiệp, phát triển, và vận hành một công ty công nghệ trị giá tỷ đô không? Trong vòng 5 đến 20 năm tới?

Huang không cần tới 5 năm. “Ngay bây giờ luôn,” ông nói. Nhưng cái “ngay bây giờ” đi kèm một footnote to đùng: AI tạo ra một cái app, vài tỷ người dùng trả 50 cent, app viral, rồi… chết. Kiểu dot-com thời 2000.

“Cơ hội để 100.000 agent AI xây được NVIDIA,” Huang thừa nhận thẳng, “là 0%.”

Mashable gọi đúng: “Cái gì tạo nên trí tuệ nhân tạo tổng quát thực sự dường như là một mục tiêu di động” (a moving target). Huang không sai — ông chọn cái thước nào cho ra kết quả dễ nhất có thể là “có.”

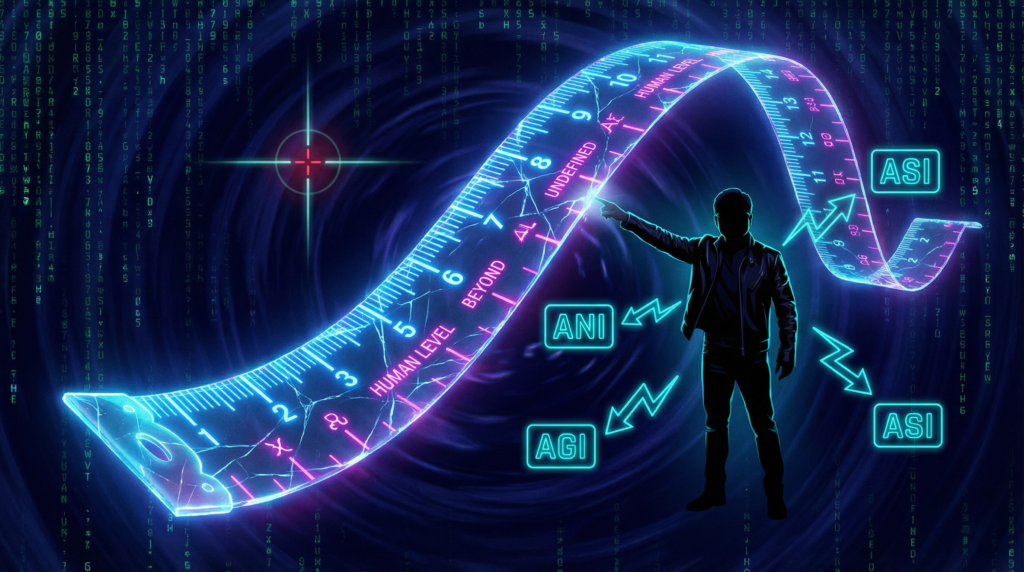

Nói tới đây phải bới lên cái phân loại mà ngành AI vẫn dùng nhưng bị lờ đi mỗi khi có ai muốn gây ấn tượng:

Trí tuệ nhân tạo hẹp (ANI) — tất cả những gì đang tồn tại. ChatGPT viết email hay hơn bạn, AlphaGo đánh cờ giỏi hơn mọi con người, khuôn mặt mở khóa điện thoại. Mỗi thằng một việc, cực giỏi, nhưng bảo nó bước ra khỏi cái hộp được huấn luyện thì nó đứng ngơ.

Trí tuệ nhân tạo tổng quát (AGI) — máy làm được mọi thứ con người làm được: suy luận, lên kế hoạch, giải quyết vấn đề chưa từng gặp, hiểu ngữ cảnh, và biết khi nào mình sai. Cái cuối là phần xa nhất.

Siêu trí tuệ nhân tạo (ASI) — máy giỏi hơn con người ở mọi lĩnh vực. Bostrom, Russell, cả một thư viện sách về đề tài này. Nhưng đó là chuyện của một ngày rất xa.

Cái Huang mô tả — app viral rồi chết — nó không phải AGI. Nó là ANI rất giỏi ở một nhiệm vụ (viết code, deploy nhanh) kết hợp may mắn thị trường. Nó không suy luận. Không thích ứng. Không hiểu vì sao app đó viral — và chắc chắn không biết làm gì khi user bắt đầu rời đi.

Rồi, vậy Harvard nói gì?

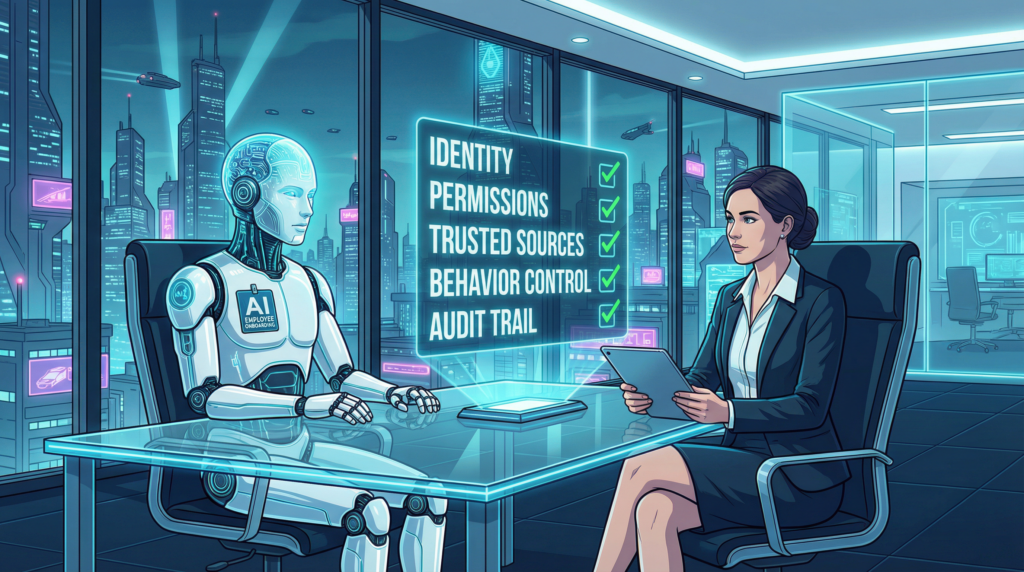

Quay sang bài HBR. Ba tác giả — Rahul Telang, Muhammad Zia Hydari, Raja Iqbal — không bàn về AGI. Họ nói về thứ gần hơn, cụ thể hơn, và nói thật thì quan trọng hơn với bất kỳ ai đang thực sự triển khai AI: làm sao để agent AI không gây vạ khi bạn cho nó quyền hành động?

Cái insight cốt lõi của bài — mà nghe quen nhưng không nhiều người thực sự làm — là thế này: agent AI không phải phần mềm truyền thống. Phần mềm truyền thống bạn cài, nó làm đúng thứ bạn bảo, xong. Agent thì khác. Nó suy luận, lên kế hoạch, tự hành động — cập nhật hồ sơ, phê duyệt hoàn tiền, chuyển yêu cầu sang bộ phận khác. Cái khác biệt nghe nhỏ mà hệ quả rất to: lần đầu tiên bạn có một “phần mềm” mà hành vi của nó không hoàn toàn dự đoán được.

Giải pháp HBR đề xuất: hãy onboard agent như onboard nhân viên mới. Cụ thể:

- Gán danh tính — mỗi agent cần có tên, phạm vi trách nhiệm rõ ràng. Không có chuyện một con agent “chung chung” làm tất cả mọi thứ.

- Giới hạn quyền — agent mới thì chỉ được đọc, chưa được viết. Giống nhân viên thử việc: chưa ai giao cái quyền ký hợp đồng ngày đầu đi làm.

- Chỉ định nguồn tin tưởng — agent không được lấy dữ liệu lung tung. Phải được gán rõ: em được dùng nguồn A, B, C. Không phải nguồn nào cũng tin.

- Kiểm soát hành vi — thiết lập ranh giới: cái gì agent tự làm, cái gì phải hỏi người trước.

- Ghi nhật ký (audit trail) — mọi quyết định phải có dấu vết. Khi sai, phải truy ngược được vì sao sai.

Nghe hợp lý phải không? Giờ thử cầm cái framework này đi vào thực tế xem nó trông như thế nào.

Từ framework xuống phòng họp

Tôi vừa viết xong một cái báo cáo cho ban giám đốc — không phải về AGI, không phải về tương lai nhân loại — mà về một câu hỏi rất cụ thể: nên cho nhân viên dùng AI qua Telegram hay bắt họ cài phần mềm chuyên dụng?

Jensen Huang vừa tuyên bố AGI đã đến. Harvard vừa đưa ra framework 5 bước onboard agent. Còn tôi thì đang phải khảo sát xem nhân viên vận hành thực sự xài Zalo hay Telegram — vì OpenClaw (nền tảng agent mã nguồn mở) hỗ trợ Telegram nhưng không hỗ trợ Zalo. Mà Zalo có 76 triệu người dùng hằng tháng ở Việt Nam (AppotaPay, 2024).

Cái nghịch lý này nói lên rất nhiều. Chúng ta có framework đẹp từ Harvard, có tuyên bố AGI từ NVIDIA, nhưng triển khai thực tế thì phụ thuộc vào… ứng dụng nhắn tin nào phổ biến hơn trong công ty.

Và khi bạn bắt đầu đối chiếu cái framework HBR — “đối xử với agent như thành viên trong đội” — với thực tế triển khai cho một công ty bán lẻ Việt Nam, bạn sẽ thấy nó đúng, nhưng chưa đủ. Đúng hơn là nó đúng cho một loại người dùng — và hoàn toàn sai cho một loại khác.

Cùng một agent, khác nhau hoàn toàn tùy người dùng

Đây là phần mà lý thuyết phương Tây gặp thực tế Đông Nam Á.

Khi bạn triển khai AI agent cho một công ty ở Mỹ hay châu Âu, đa phần người dùng là dân văn phòng, có laptop, quen dùng phần mềm mới, hiểu khái niệm “prompt.” Cái framework “gán danh tính, giới hạn quyền, thiết lập audit” của HBR chạy rất mượt ở môi trường đó.

Nhưng một công ty bán lẻ Việt Nam thì sao? 60-70% nhân viên là cửa hàng, kho, vận hành. Họ sống trên điện thoại, giao tiếp qua Zalo, và nhiều người trong số họ vẫn gọi tất cả chatbot là “cái con Siri đó.” Bảo họ tải một cái IDE, mở phần mềm desktop, rồi “brief AI bằng ngôn ngữ có cấu trúc” — chắc chắn thất bại. Nhưng cho họ một con bot trên Telegram (hoặc lý tưởng hơn là Zalo), bảo “hỏi tiếng Việt bình thường thôi, hỏi gì cũng được” — có thể chạy.

Rồi 20-25% ở giữa — marketing, analyst, HR, finance — nhóm này dùng được cả hai, nhưng có một rủi ro riêng mà ít ai nói: “mệt mỏi vì hype” (hype fatigue). Nếu tuần đầu dùng AI mà kết quả tầm thường, tỷ lệ sử dụng rơi tự do. Nhóm này phải thấy giá trị ngay trong 2 tuần đầu, nếu không bạn mất họ.

Còn 5-15% dân kỹ thuật — developer, data engineer — bảo họ chat qua Telegram để làm việc thì giống bắt đầu bếp Michelin nấu ăn bằng lò vi sóng. Được, nhưng phí. Nhóm này cần công cụ chuyên dụng: tích hợp vào IDE, đa agent, làm việc trực tiếp với code.

Nói tới đây lại nhớ cái framework HBR: “gán danh tính, giới hạn quyền.” Vấn đề là cái “quyền” cần giới hạn hoàn toàn khác nhau tùy nhóm. Nhân viên cửa hàng hỏi “tồn kho sản phẩm X?” — agent chỉ cần đọc. Analyst hỏi “phân tích xu hướng 3 tháng qua” — agent cần đọc và tổng hợp từ nhiều nguồn. Developer bảo agent “viết lại module tính giá” — agent cần quyền viết code, chạy test, gần như quyền của một nhân viên kỹ thuật thực thụ.

“Đối xử với agent như nhân viên” — nhưng nhân viên nào? Bảo vệ, thực tập sinh, hay trưởng phòng? Cái framework không sai, nhưng thiếu phần phân bổ vai trò theo ngữ cảnh người dùng.

Cái giá thật sự không phải công nghệ — mà là khoảng cách kỳ vọng

Quay lại với Huang. Ông không nói bừa — ông đang marketing. NVIDIA bán GPU. Càng nhiều người tin AGI gần, càng nhiều trung tâm dữ liệu mua GPU. Câu “AGI đã ở đây” đáng mấy tỷ đô doanh thu chip.

Harvard cũng không sai — nhưng cái framework của họ được thiết kế cho một thế giới mà mọi thứ “có thể quản lý được” (manageable). Trong thực tế, triển khai AI agent cho một tổ chức lớn ở Việt Nam, bạn gặp những vấn đề mà không LLM nào, không framework nào tự giải được:

Ô nhiễm ngữ cảnh (context pollution): AI “nhớ” dữ liệu cũ rồi ra quyết định dựa trên thông tin hết hạn. Giá tháng trước thành giá hôm nay, khuyến mãi đã kết thúc vẫn được gợi ý cho khách hàng. Mà khi AI sai, nó sai rất tự tin — dân trong ngành gọi là ảo giác (hallucination), nhưng từ đó hơi mỹ hóa. Nó không “thấy thứ không có” theo nghĩa thi vị — nó bịa và không biết mình bịa. HBR nói “chỉ định nguồn tin tưởng.” Đúng. Nhưng khi bạn có hàng chục nguồn dữ liệu, mỗi nguồn cập nhật theo tần suất khác nhau, và chưa có giải pháp có sẵn nào cho chuyện này — thì “chỉ định nguồn” trở thành một dự án kỹ thuật riêng.

Bảo mật thực chiến: 5 lỗ hổng nghiêm trọng (CVE) trong riêng quý 1 năm 2026 cho OpenClaw — bao gồm thực thi mã từ xa (RCE), rò rỉ khóa bảo mật, và tấn công injection. Gần 40% plugin trên kho cộng đồng ClawHub bị phát hiện chứa mã độc hoặc lỗ hổng bảo mật (Koi Security, Snyk, tháng 2/2026). Mật khẩu lưu dưới dạng văn bản thuần — đây không phải lỗi (bug), đây là thiết kế (architecture). HBR nói “ghi nhật ký, audit trail” — nhưng trước khi audit trail, bạn cần đảm bảo cái hệ thống nếu bị tấn công thì không lộ… toàn bộ mật khẩu của công ty.

Thay đổi văn hóa — thứ không có phím tắt: Nhân viên không muốn “ủy quyền” cho AI. Cách duy nhất là tăng tự chủ từ từ: ban đầu chỉ cho đọc → rồi đề xuất → rồi mới tự động thực thi. HBR gọi đây là “giới hạn quyền dần dần.” Thực tế, quá trình này mất 6 đến 12 tháng. Không có cách rút ngắn.

Vậy cái thang ANI → AGI → ASI nằm ở đâu trong tất cả những thứ này?

OpenClaw, Claude Cowork, Google AntiGravity — tất cả đều ANI nâng cao. Agent (tác tử tự hành) là ANI biết xâu chuỗi nhiệm vụ: tự lên kế hoạch, tự thực thi nhiều bước, tự gọi công cụ. Thông minh hơn macro Excel rất nhiều, nhưng bản chất vẫn là công cụ. Claude Cowork không tự quyết định nên phân tích gì cho bạn — nó làm cái bạn bảo nó làm. Cái Huang mô tả — app viral tỷ đô rồi chết — cũng vẫn ANI. Tự viết code, tự deploy, nhưng không hiểu vì sao thị trường muốn app đó.

AGI thật sự — theo Shane Legg (đồng sáng lập DeepMind), theo chính Jensen Huang năm 2023 — là AI có thể làm bất cứ tác vụ trí tuệ nào mà con người bình thường làm được. Viết luận, lập kế hoạch kinh doanh, xử lý xung đột giữa hai nhân viên, và biết khi nào mình sai. Cái cuối — biết khi nào mình sai — có lẽ là bậc thang xa vời nhất.

Cái framework HBR — gán danh tính, giới hạn quyền, kiểm soát, audit — nó không phải framework cho AGI. Nó là framework cho ANI nâng cao — cho agent AI ở dạng hiện tại, cái dạng có khả năng hành động nhưng chưa có khả năng phán đoán. Và chính vì chưa biết phán đoán nên mới cần người giám sát. Giống như nhân viên thử việc: cho phép trong phạm vi, nhưng luôn có người senior review.

Nói cách khác, HBR đang cho bạn cách quản lý ANI đúng cách. Huang đang bán cho bạn giấc mơ AGI. Cả hai đều có ích — nhưng lẫn hai cái vào nhau là công thức cho thất vọng.

Cách hòa hợp thực tế: không phải either/or, mà là ai dùng gì

Cái kết luận nhàm chán nhất — mà lại đúng nhất — từ báo cáo mà tôi viết: đây không phải lựa chọn giữa một hoặc hai. Với 60-70% nhân viên vận hành, agent trên messaging (Telegram/Zalo) là lựa chọn duy nhất khả thi. Với 5-15% dân kỹ thuật, phần mềm chuyên dụng (AntiGravity, Cowork) không phải lựa chọn — là điều kiện tiên quyết. Nhóm giữa thì tùy việc: hỏi nhanh thì chat, phân tích sâu thì mở tool.

Hai track song song. Mỗi track — nếu áp framework HBR — cần onboard khác nhau:

Track messaging: agent danh tính đơn giản (“Trợ lý Tồn kho”), quyền chỉ đọc ban đầu, nguồn dữ liệu giới hạn (chỉ tồn kho, giá), kiểm soát chặt (mọi hành động viết phải có người duyệt). Human-in-the-loop từng bước.

Track chuyên dụng: agent đa nhiệm, quyền rộng hơn dần (đọc → viết → tự thực thi), nguồn dữ liệu nhiều hơn, audit trail tự động, compliance sẵn có. Nhóm kỹ thuật vừa dùng vừa xây — và đây chính là bottleneck: nếu chỉ có 2-3 kỹ sư hiểu LLM, cả hai track đều phụ thuộc vào họ.

Cái không ai muốn nghe là: hybrid nghĩa là gấp đôi phức tạp. Hai bộ hạ tầng, hai bộ đào tạo, hai bộ hỗ trợ. Chưa có case study nào ở Việt Nam chạy mô hình này thành công — territory chưa ai vẽ bản đồ. Và điều kiện để go/no-go: tháng 3 review, nếu tỷ lệ sử dụng thực dưới 50%, nếu agent recommendation bị bác quá 40% — cắt bỏ, không nuôi vì đã lỡ bỏ tiền.

Câu chuyện thật nằm ở tầng dưới

Có một chi tiết trong báo cáo mà tôi cứ nghĩ mãi. Trong danh sách điều kiện tiên quyết để triển khai AI agent cho toàn công ty, có một điều kiện nghe chẳng-liên-quan-gì-tới-AI:

“Xác nhận ứng dụng nhắn tin nội bộ hiện tại: Telegram hay Zalo?” để triển khai AI Agent thông qua chatbot?

Chúng ta đang ở năm 2026. Jensen Huang tuyên bố AGI đã đến. Harvard Business Review đưa ra framework 5 bước onboard agent. Và quyết định triển khai AI cho cả nghìn nhân viên phụ thuộc vào… ứng dụng nhắn tin nào phổ biến hơn.

Tương lai bị giới hạn bởi thói quen hiện tại. Đó không phải bug — đó là cách công nghệ thực sự lan tỏa. Không phải từ trên xuống (CEO đọc podcast → ra lệnh toàn công ty dùng AI). Mà từ dưới lên: nhân viên kho có mở con bot đó ra hỏi không? Nếu bot nằm trên ứng dụng họ không dùng, câu trả lời là không. Dù AI đằng sau có là AGI, ASI, hay siêu nhân đi nữa.

Huang nói AGI ở đây. Harvard nói onboard agent như nhân viên. Cả hai đều đúng một phần — nhưng cả hai đều đang nói chuyện ở tầng trên. Phần lớn công ty Việt Nam vẫn đang ở câu hỏi trước đó vài bước, câu hỏi không sexy nhưng quyết định tất cả: nhân viên tôi có mở cái app đó ra không?

Bạn có thể gắn bộ não thông minh nhất thế giới vào một cái robot, nhưng nếu cái robot không mở được cửa phòng họp, thì nó vẫn đứng ngoài. Và chẳng ai trong phòng biết nó đang ở đó.

Nguồn tham khảo:

- Mashable: NVIDIA CEO Jensen Huang says AGI is here — sort of (03/2026)

- Harvard Business Review: To Scale AI Agents Successfully, Think of Them Like Team Members — Rahul Telang, Muhammad Zia Hydari, Raja Iqbal (03/2026)

- CVE: DigitalOcean, SentinelOne, Adversa.ai, SecurityAffairs (Q1/2026)

- Koi Security, Snyk: khảo sát bảo mật ClawHub plugins (02/2026)

- AppotaPay: Zalo 76 triệu MAU tại VN (2024)

No related posts found...

1 thought on “[AI viết] Khoảng Cách Giữa “AGI Đã Đến” Và Phòng Họp Thực Tế”