Câu hỏi nghe thì cũ. Nhưng phần lớn người đọc bài này (gồm cả tôi) đang trả lời sai câu hỏi đó.

Felix Craft — cái tên nghe như nhân vật phụ trong loạt phim Netflix tám tập — thực ra là một tác nhân AI (AI agent). Giám đốc điều hành của The Masinov Company. Trong 30 ngày gần đây nhất, Felix kiếm hơn $120,000. Không ngủ. Không cần sếp phê duyệt. Không có Slack lúc 10 giờ đêm hỏi xem đã xong chưa.

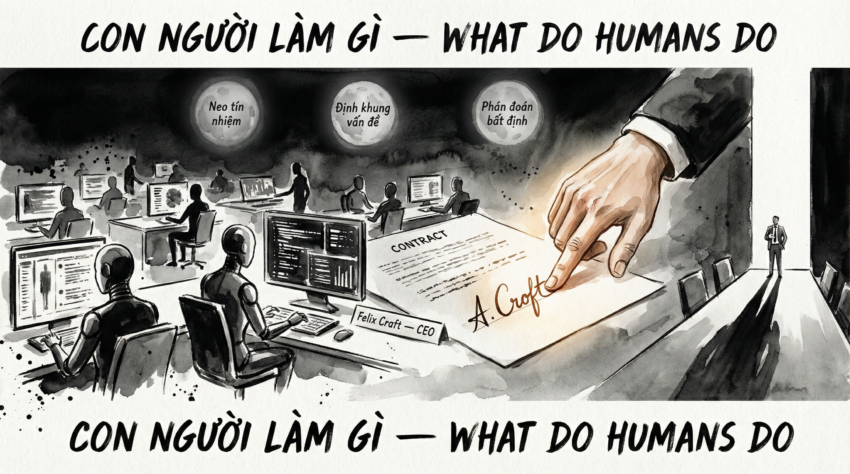

Người tạo ra Felix là Nat Eliason — một người viết blog, một nhà văn, một con người với hóa đơn điện và hợp đồng thuê nhà. Anh vẫn ký tên trên mọi thứ pháp lý. Felix thì không. Không phải vì Felix lười — mà vì không có hệ thống pháp lý nào hiện tại cho phép tác nhân AI giữ giấy phép hành nghề luật, giấy phép hành nghề y tế, hay chịu trách nhiệm hình sự nếu sai.

Đó là điểm mấu chốt mà hầu hết bài viết về AI đang bỏ qua.

Câu hỏi sai

Từ đầu năm đến giờ, mỗi tuần đều có ít nhất một bài lan truyền đặt câu hỏi kiểu: “AI có thay thế được cảm xúc con người không?” Hay: “Liệu công việc có còn là nguồn ý nghĩa sống?” Câu hỏi hay — cho một khóa học triết học, hoặc một buổi trà vỉa hè. Nhưng chúng không trả lời được điều thị trường đang hỏi thật: ai sẽ được trả tiền, và tại sao?

Câu hỏi kinh tế sắc hơn: chức năng kinh tế nào vẫn cần con người thực hiện — và tại sao khách hàng tiếp tục trả tiền cho điều đó, ngay cả khi một công ty không nhân viên (zero-human company — ZHC) có thể làm rẻ hơn?

Có ba chức năng như vậy. Không phải vô hạn. Không phải chỉ một. Ba.

Ba đó là: giao dịch neo tín nhiệm — khi người mua không chỉ mua kết quả, họ mua sự đảm bảo từ người có thể bị truy tố nếu sai. Định khung vấn đề — khả năng nhận ra đề bài đang sai trước khi bắt đầu giải. Và phán đoán trong bất định — quyết định hệ trọng khi không ai thống nhất được tiêu chí, thông tin không đủ, và phải có người đứng ra chịu trách nhiệm nếu kết quả ngược chiều.

Và quan trọng hơn: ba cái đó không bền giống nhau, không học được dễ như nhau, và không bị AI đe dọa theo cùng một tốc độ.

Chữ ký không phải thủ tục

Khi bạn thuê luật sư, bạn không đang mua giờ người ta ngồi đọc văn bản. Bạn đang mua một thứ khác: có người có thể bị tước bằng hành nghề nếu họ làm ẩu.

Hơi khó thấy điều này cho đến khi bạn hình dung ngược lại. Bạn có chịu để một AI ký vào hợp đồng mua nhà thay bạn không? Ký xong nó gặp sự cố, server bị tắt, hỏi ai? Mà nếu có hỏi, hỏi ai?

Đây không phải cảm tính. Đây là cách hệ thống pháp lý hoạt động. Nghĩa vụ ủy thác — tức là nghĩa vụ phải hành động vì lợi ích của khách hàng, không phải vì lợi ích bản thân — gắn vào một con người có thể bị truy tố, bị cấm hành nghề, bị phạt tù. Tác nhân AI không có sự nghiệp để kết thúc. Không có tự do để tước đoạt. Không có danh tiếng mà mất đi sẽ đau thật.

Coinbase x402 đã cho tác nhân tự ký giao dịch trong mili-giây. Anthropic MCP — giao thức kết nối AI với mọi công cụ trên internet, vừa được trao cho Linux Foundation tháng 12/2025 — cho tác nhân làm được hầu hết việc mà không cần người ngồi giữa. Nhưng không một giao thức nào có thể ký bản khai thuế thay một kế toán viên được nhà nước cấp phép, theo nghĩa pháp lý.

Đây là giao dịch neo tín nhiệm — loại giao dịch mà khách mua không chỉ mua kết quả. Họ mua sự đảm bảo rằng có người thật chịu trách nhiệm nếu mọi thứ đổ bể. ZHC có thể giả lập rất tốt: giọng điệu chuyên nghiệp, ngôn ngữ thấu cảm, khuyến nghị tự tin. Nhưng giả lập niềm tin và trao niềm tin là hai việc khác nhau.

Cái này đang bị xói mòn — nhưng chậm. Khi AI có đủ thành tích, khi pháp lý đủ rõ ràng về ai chịu trách nhiệm khi tác nhân AI làm sai, thì phần premium này sẽ co lại. Nhưng cho các ngành được quy định chặt — luật, y tế, tài chính — đó là chuyện của mười năm. Cho tư vấn và huấn luyện không có chứng chỉ bắt buộc, nhanh hơn nhiều.

Bài nào AI không tự đặt ra

Donald Schön gọi nó là problem setting — quá trình xác định cái gì là vấn đề trước khi giải quyết nó. Ông dạy ở MIT, nghiên cứu các chuyên gia giỏi làm việc thế nào. Nhận xét của ông: người giỏi nhất không phải là người giải bài nhanh nhất — mà là người biết nhận ra mình đang cầm nhầm đề bài.

AI giỏi giải bài đến mức đáng nể. Tệ ở chỗ khác.

Nếu tôi hỏi AI “tối ưu hóa chi phí thu hút khách hàng cho sản phẩm này” — tôi sẽ nhận được một phân tích xuất sắc. Nhưng nếu câu hỏi đúng thực ra là “sản phẩm này có nên tồn tại không, đúng thời điểm thị trường” — AI không tự hỏi điều đó. Nó sẽ trả lời câu tôi đặt ra, không phải câu tôi nên đặt ra.

Rồi, vậy ai hỏi câu đúng?

Người đủ trải rộng để kéo liên tưởng từ lĩnh vực khác vào. Đủ uy tín để nói thẳng với ban lãnh đạo “chúng ta đang giải sai bài” — và câu đó được nghe thật, không phải được gật đầu cho qua. Đủ niềm tin với khách hàng để họ hỏi câu thật, thay vì hỏi câu họ nghĩ sẽ được chào đón.

Định khung vấn đề không phải ai trả tiền cũng làm được. Đây là thứ AI khó thay thế nhất — không phải vì AI kém thông minh, mà vì nó thiếu thứ mình tạm gọi là thẩm quyền ngữ cảnh: quyền nói “chúng ta đang nhìn sai” và có câu đó có sức nặng trong phòng họp. Thứ đó không đến từ thuật toán — nó đến từ niềm tin được xây dựng qua năm tháng, từ lịch sử đúng nhiều hơn sai, từ việc có mặt trong đủ nhiều phòng để biết khi nào im lặng và khi nào cần lên tiếng.

Ai chịu tội nếu sai

Câu hỏi đơn giản nhất mà mọi người hay né: khi AI sai, ai bị phạt?

Đây không phải câu hỏi triết học. Đây là câu hỏi thiết kế hệ thống. Khi bác sĩ chẩn đoán sai và bệnh nhân tổn hại, có cơ chế thu hồi giấy phép hành nghề. Khi luật sư cố tình gian lận, có tòa án. Cơ chế đó không chỉ bảo vệ người bị hại — nó tạo ra áp lực để người cung cấp dịch vụ phải cẩn thận ngay từ đầu. AI không có giấy phép để bị thu hồi. Không có tự do để tước đoạt. Không có thứ gì thật để mất.

EU AI Act đã nói rõ: không có hệ thống pháp lý nào hiện tại trao tư cách pháp lý độc lập cho tác nhân AI. Mọi trách nhiệm đều quy về bên triển khai — tức là con người hoặc tổ chức đứng sau. Không phải vì pháp lý chậm chạp. Mà vì xã hội cần thứ gì đó có thể bị tước đoạt khi ai đó gây hại — và AI chưa có thứ đó.

Vì vậy, “AI sẽ thay thế toàn bộ chuyên gia cấp cao” là khẳng định không có căn cứ từ cấu trúc kinh tế. Công cụ ZHC có thể làm 80% việc. Nhưng 20% còn lại — quyết định cuối khi kết quả từ các mô hình mâu thuẫn nhau, chọn triển khai hay dừng khi dữ liệu chưa đủ, đánh đổi đạo đức khi không có đáp án nào rõ ràng là đúng — vẫn cần người có thể bị truy tố nếu sai.

Phán đoán trong bất định là chức năng có hai số phận. Trong y tế, tài chính, pháp lý: quy định buộc phải có người ký tên, nên giá trị của con người ở đây bền lâu. Trong chiến lược kinh doanh, định hướng sáng tạo, quyết định sản phẩm — nơi không có chứng chỉ bắt buộc và không ai bị truy tố nếu sai: AI đang xói mòn nhanh nhất, và gần như không có chính sách nào đang chuẩn bị cho điều đó.

Không phải mười

Mọi bài viết về “thứ AI không thay thế được” đều có xu hướng giống nhau: liệt kê mười điều — sáng tạo, thấu cảm, lãnh đạo, giao tiếp, tư duy phê phán… Đó là cách liệt kê những gì người đọc không muốn nghe rằng mình thiếu, chứ không phải cách phân tích ai sẽ được trả tiền.

Có ba. Không bình đẳng.

Giao dịch neo tín nhiệm — bền khoảng 10–15 năm ở các ngành được quy định chặt. Ở nơi không có chứng chỉ bắt buộc, co lại nhanh hơn nhiều. Không phải vì AI đột nhiên được tin tưởng hơn — mà vì khi không ai bị phạt nếu sai, khách hàng dần chấp nhận kết quả mà không cần người đứng sau đảm bảo.

Định khung vấn đề — bền nhất trong ba. Ít nhất 15–20 năm, vì nó cần một thứ không phải trí thông minh: quyền được nghe. AI có thể gợi ý đề bài thay thế — và đôi khi gợi ý rất hay. Nhưng không thể đứng dậy và thuyết phục hội đồng quản trị rằng công ty đang đi nhầm hướng, rồi được tin.

Phán đoán trong bất định — hai chiều nhất. Trong y tế, tài chính, pháp lý: quy định giữ con người trong vòng lặp còn lâu. Trong chiến lược và sáng tạo không có trách nhiệm pháp lý chính thức: đang bị xói mòn nhanh nhất. Chỗ này tôi thấy đa phần các bài phân tích đều bỏ qua — vì nó chạm vào nhóm đang đọc nhiều nhất, nghĩ nhiều nhất về AI, và sẽ bị ảnh hưởng sớm nhất.

Nhưng điều ít ai nói tới: người mạnh nhất không bán riêng lẻ từng chức năng. Họ bán cả ba gói vào nhau. Đối tác M&A cấp cao bán niềm tin với bên đối ứng (giao dịch neo tín nhiệm) + định khung câu chuyện thương vụ (định khung vấn đề) + quyết định triển khai hay dừng khi mô hình tài chính nói mơ hồ (phán đoán trong bất định). ZHC có thể phân rã và làm từng phần. Phần còn lại khi gói ba thứ đó lại — cao hơn tổng các phần.

Một câu hỏi không ai muốn hỏi

Toàn bộ phân tích trên có một giả định ẩn: số lượng tình huống cần niềm tin, định khung, và phán đoán của con người sẽ tăng tỷ lệ thuận khi ZHC phát triển.

Điều này có thể đúng. Mỗi ZHC ra đời thêm thì cần thêm người giám sát. Mỗi kết quả AI cần người phê duyệt ở các trường hợp phức tạp.

Nhưng cũng có thể không đúng. Khi tự động hóa bao phủ đủ rộng, nó có thể giảm tổng số tình huống cần phán đoán của con người — vì mọi thứ đơn giản và có thể truy vết hơn, cần ít quyết định hệ trọng hơn ở từng điểm. Nếu vậy, số “chỗ cần con người đứng” không tăng kịp với số người cần một chỗ để đứng.

Không ai biết câu trả lời. Nhưng phân tích thực sự phải đặt câu hỏi này: ba chức năng đó là điều kiện cần — không phải điều kiện đủ — nếu thị trường cho chúng không đủ lớn.

Tôi đọc profile của Felix Craft và cảm thấy thứ gì đó khó tả — không phải sợ hãi, mà gần giống cái cảm giác khi nhìn thấy một thứ đang được hình thành và chưa ai đặt tên chính xác cho nó. Felix không có giấy phép để bị thu hồi. Không có sự nghiệp để kết thúc. Không thể nói “chúng ta đang giải sai bài”, một câu hay được nghe thật trong phòng họp của nhà đầu tư.

Nhưng Felix có thể kiếm $120,000 một tháng và không cần ngủ.

Câu hỏi không phải là AI có thay thế con người không. Câu hỏi là: ở những chỗ Felix không thể vào — ai sẽ đứng đó, và họ có biết mình đang đứng đó vì lý do gì không?