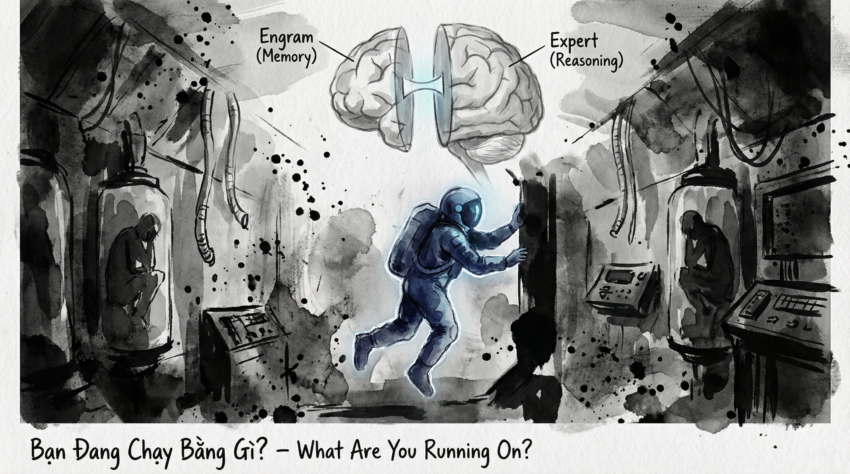

Ryland Grace tỉnh dậy trong một căn phòng trắng, không biết mình là ai.

Không nhớ tên. Không nhớ nghề nghiệp. Không nhớ tại sao mình lại ở đây. Xung quanh là máy móc, ống truyền dịch, và ba cái xác người đã đông lạnh trong giường bên cạnh. Ông bắt đầu từ đầu — quan sát từng chi tiết nhỏ, suy luận từng mắt xích. Trọng lực này là nhân tạo. Nguồn sáng từ đây. Không khí đang được lọc. Từ những mảnh vụn đó ông tự dựng lại bức tranh: mình đang ở trên tàu vũ trụ, một mình, cách Trái Đất nhiều năm ánh sáng.

Không có ký ức nào để dựa vào. Không có pattern cũ nào để kéo ra. Chỉ có quan sát và suy luận, thuần túy.

Project Hail Mary của Phil Lord và Christopher Miller — phim đang chiếu rạp từ tháng 3/2026, chuyển thể từ tiểu thuyết của Andy Weir — là bộ phim về rất nhiều thứ: về sự sống còn, về tình bạn xuyên hành tinh, về hy sinh. Nhưng nếu đọc kỹ hơn một chút, nó là bộ phim về điều mà một nhóm kỹ sư Trung Quốc đã tìm ra trong một bài báo công bố ngày 12 tháng 1 năm 2026.

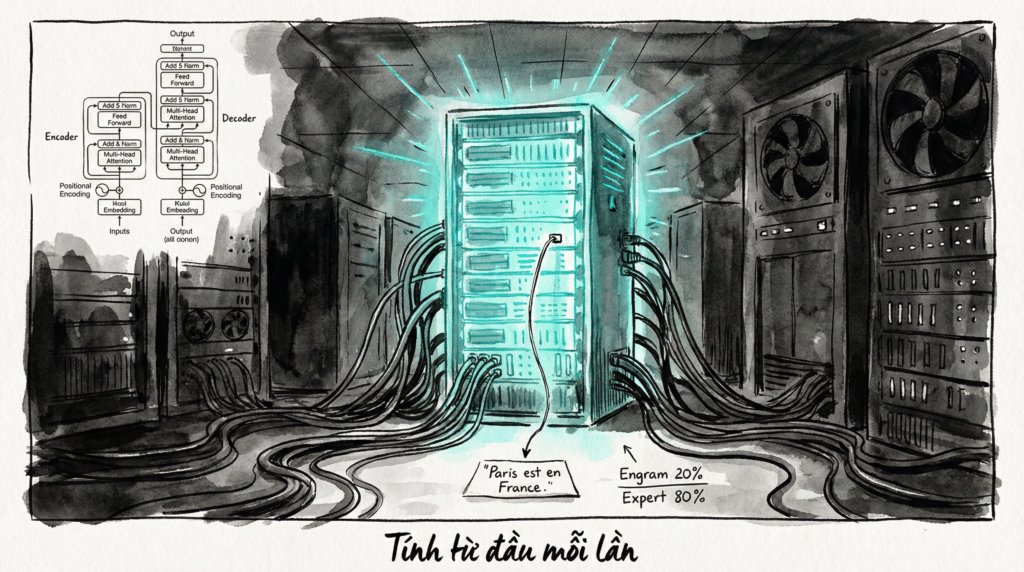

Tính từ đầu mỗi lần

Bài báo đó tên là “Conditional Memory via Scalable Lookup.” Tên nghe khô như gỗ.

Nhưng câu nằm ở trang đầu mới đáng đọc: “Chúng ta đang dùng một siêu máy tính chỉ để xác nhận rằng Paris nằm ở Pháp.”

Nhóm DeepSeek tìm ra rằng kiến trúc Transformer — thứ đứng sau mọi mô hình ngôn ngữ lớn hiện nay — không phân biệt giữa cái cần tư duy và cái chỉ cần nhớ lại. Mỗi lần bạn hỏi về Diana, Công nương xứ Wales, mô hình không đơn giản là “tra” thông tin. Nó tái dựng lại toàn bộ khái niệm Diana từ các lớp neural, từng bước một. DeepSeek gọi đây là “expensive runtime reconstruction of a static lookup table.” Tốn tiền tính lại cái đã biết sẵn.

Giải pháp là module mới mang tên Engram — ghép từ “N-gram” trong ngữ học tính toán cổ điển và “engram” trong thần kinh học (dấu vết ký ức trong não). Engram không tính toán. Nó tra cứu. Và với cái Gate — bộ lọc bảo vệ ở giữa — nó kiểm tra xem ký ức tra về có thực sự khớp với ngữ cảnh hiện tại không, trước khi cho kết quả chạy vào vùng suy nghĩ.

Tỷ lệ tối ưu họ tìm ra qua thực nghiệm: khoảng 20–25% tham số dành cho Engram (bộ nhớ cố định), 75–80% còn lại dành cho Expert (vùng suy luận). Vượt qua ngưỡng đó, hệ thống bắt đầu bị “Hash Collision”: cái nhớ sai được kéo ra với sự tự tin cao. Thấy từ “Bank” → kéo ngay ảnh bờ sông, dù đang nói về tài khoản tiết kiệm. Nhớ nhiều quá thành ra sai.

Grace trong Project Hail Mary tỉnh dậy với Engram gần như trống rỗng. Và chính vì thế ông là nhân vật có khả năng suy luận rõ ràng nhất trong phim. Không có cache cũ nào kéo ông về hướng sai. Không có pattern nào bảo ông “đây là cách phải làm.” Ông chỉ nhìn, quan sát, và nghĩ.

Bộ nhớ giải phóng hay cầm tù?

Tina He — tác giả bài viết gốc trên Fakepixels — kéo quan sát DeepSeek sang chiều người. Bà ngồi trong một quán cà phê ở San Francisco, nhìn một đứa trẻ đang đếm ngón tay để tính 7×8. Người mẹ ngồi bên cạnh, kiên nhẫn nhưng mỏi mệt: “Con nhớ không? Đừng nghĩ nữa. Biết đi.”

Đúng ra là thế.

Giáo dục kiểu Tây coi thuộc lòng là dấu hiệu của sự thiếu hiểu biết. Cái quan trọng là tư duy phản biện. Kết quả: sinh ra học sinh có thể giải thích tại sao phép nhân hoạt động, nhưng không biết tự tính tiền tip mà không dùng điện thoại. CPU quá tải, quên mất rằng có những thứ chỉ cần biết, không cần suy.

Giáo dục kiểu Đông — Gaokao, Hagwon, Kumon — đi hướng ngược: nhồi pattern vào bộ nhớ bằng lặp đi lặp lại. Kết quả: giải bài tích phân như máy, nhưng gặp biến số mới là tắt máy. Lookup table quá nặng, không còn margin cho logic.

Cả hai đều sai. Sai theo hướng đối lập.

Khi DeepSeek cho phép mô hình ghi nhớ những pattern đơn giản — thành ngữ, cụm từ thường gặp, các sự kiện hiển nhiên — hiệu suất suy luận tăng vọt, vượt xa cả phần kiến thức được nạp thêm. Vì tư duy không phải vô hạn. Nó là ngân sách. Mỗi giây não dùng để tính lại cái đã biết là một giây không dùng được cho cái thực sự cần nghĩ.

Một nghệ sĩ dương cầm chơi Rachmaninoff không nghĩ từng nốt. Kỹ thuật đã bị đẩy vào vùng tối của thói quen — để vùng sáng của ý thức tập trung vào cảm xúc bài nhạc. Nếu phải tính toán từng ngón, bản nhạc sẽ vỡ vụn từ đầu.

Nhớ không phải giới hạn của tư duy. Nhớ là điều kiện để tư duy thực sự bắt đầu.

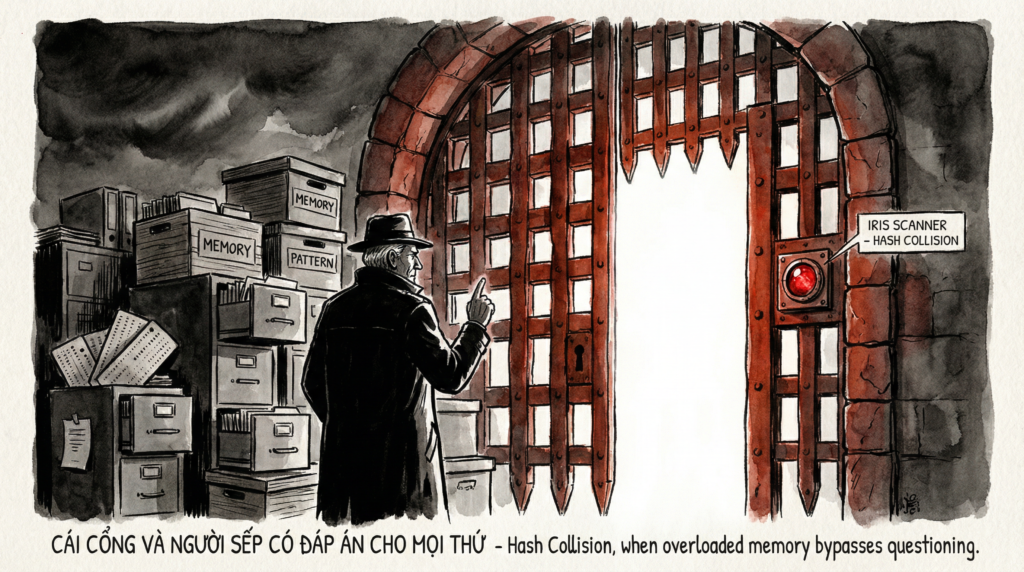

Cái Cổng và người sếp có đáp án cho mọi thứ

Nhưng đây mới là phần đáng sợ.

Khi bộ nhớ vượt quá ngưỡng tối ưu, hệ thống không chỉ sai — mà sai với sự tự tin cao. Nó không biết mình đang sai. Chỉ kéo ra câu trả lời quen thuộc nhất và chạy tiếp.

DeepSeek gọi đây là Hash Collision. Với người, ta gọi nó là “kinh nghiệm.”

Hình ảnh Tina He dùng là partner luật sư trong phòng kính. Ông từng thấy tất cả. Ngắt lời bạn trước khi bạn nói xong câu — không phải vì thiếu tôn trọng, mà vì ông thực sự nghĩ ông biết bạn đang hỏi gì. Thường thì ông đúng. Nhưng khi thị trường thay đổi cấu trúc — ông kéo ra cùng một bộ công cụ. Nhanh. Có thẩm quyền. Và sai.

Không phải ông thiếu thông minh. Ông bị quá tải bộ nhớ. Recall đã kẹp chặt questioning.

Cái Gate trong kiến trúc Engram sinh ra để chặn đúng điều đó. Nó hỏi: “Ký ức này có thực sự khớp với cái đang xảy ra ngay bây giờ không?” Trước khi để bộ nhớ nắm quyền điều hành, Gate so sánh pattern cũ với thực tế hiện tại. Không khớp — nó tắt bộ nhớ, trả quyền lại cho vùng suy luận.

Project Hail Mary có một nhân vật minh họa điều này chính xác hơn bất kỳ giáo trình quản trị nào.

Eva Stratt — người chịu trách nhiệm lập kế hoạch cứu nhân loại — ép Grace lên tàu dù ông không tình nguyện. Bà không ác. Và quyết định của bà không sai — Trái Đất được cứu nhờ đúng quyết định đó. Nhưng bà đang chạy một cache không được hỏi lại: “Nhiệm vụ hoàn thành = người thực hiện trở về.” Pattern đó đúng trong hàng triệu bối cảnh quân sự, tổ chức, lịch sử. Không ai nghi ngờ nó.

Cái hash collision không nằm ở lúc Grace được gửi đi. Nó nằm ở lúc loài người mặc định rằng kết thúc tốt nhất cho Grace là trở về — mà không ai thực sự hỏi Grace câu đó lần cuối.

Tín hiệu đã có sẵn từ lâu

Tác giả của Systematic Long Short — người từng quản lý đội ~20 người tại một quỹ phòng hộ rồi bỏ tất cả để xây startup từ đầu — có một luận điểm đơn giản đến mức gần như bực bội:

“Các tín hiệu tạo nên điểm bùng phát luôn có thể đọc được từ trước — nếu bạn chịu nhìn.”

Điểm bùng phát với ông là ChatGPT o1: lần đầu tiên ông thấy AI viết code thực sự dùng được từ một prompt có cấu trúc. Không phải vì nó hoàn hảo. Mà vì ngưỡng mà tại đó AI viết ít bug hơn người trung bình, với tốc độ cao hơn — ngưỡng đó thấp một cách đáng ngạc nhiên, và đã được chạm tới.

“Bất động trong điều kiện thiếu thông tin là sự suy thoái. Di chuyển là khám phá.”

Ông liệt kê bốn nhóm còn thở được một lúc: dữ liệu độc quyền, ma sát pháp lý, thẩm quyền-như-dịch-vụ (authority as a service), và khoảng chậm trễ của phần cứng. Nhưng ông nói thẳng: tất cả đều là bộ nhớ đệm có thời hạn, không phải tấm chắn vĩnh viễn.

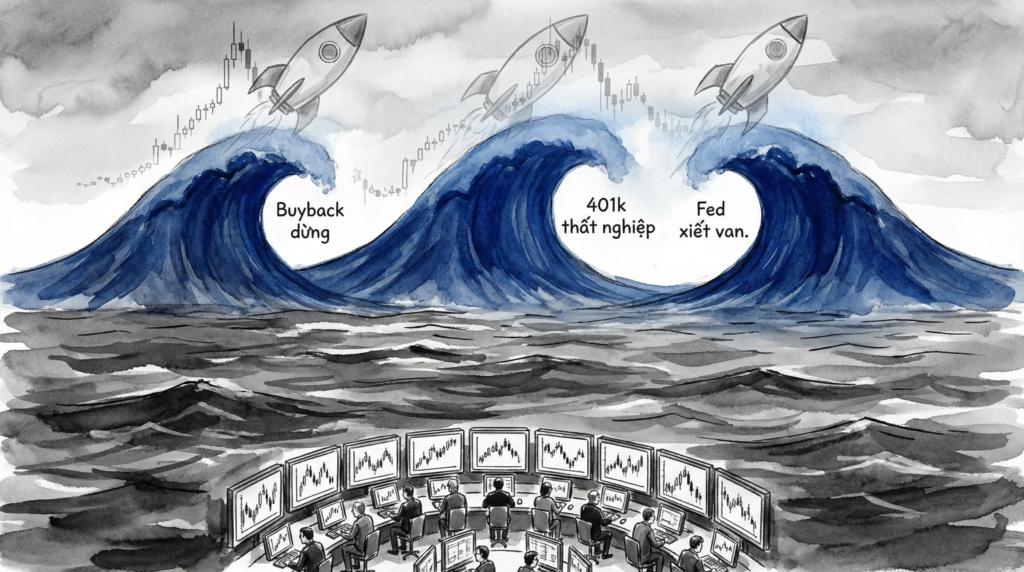

Ba con sóng đang đổ về cùng lúc

chumba — tác giả bài “Doomer or Boomer” — không phải chiến lược gia. Ông là trader, viết với giọng người đang hedge. Nhưng bộ khung ông dựng mới là thứ đáng đọc.

Trong 16 năm qua, thị trường chứng khoán Mỹ được chống đỡ bởi ba cột trụ đang đồng thời lung lay — và cả ba đều liên quan trực tiếp đến AI.

Cột đầu tiên sụp là dòng tiền mua lại cổ phiếu (buyback) của các công ty công nghệ lớn. Microsoft, Google, Meta, Amazon đã bỏ ra khoảng 380 tỷ đô năm 2025 cho hạ tầng AI — dự báo 2026 hơn 650 tỷ, chiếm gần 90% dòng tiền hoạt động. Tiền không còn để mua lại cổ phiếu. Không phải vì không muốn — mà vì không cắt thì không tồn tại.

Cột thứ hai lung lay chậm hơn nhưng sẽ đau hơn: dòng tiền thụ động từ các khoản đóng tiết kiệm hưu trí 401k của người lao động Mỹ, chiếm khoảng 50–60% thị trường, hàng tháng tự chảy vào quỹ chỉ số bất kể giá. Cái gì dừng được dòng tiền này? Thất nghiệp. Mà AI đang tạo ra chính xác động lực để các công ty đẩy nhanh quá trình đó.

Cột thứ ba là thanh khoản mà Fed bơm vào suốt từ 2008 — bảng cân đối tài sản tăng hơn 700% so với trước khủng hoảng. Nếu Chủ tịch Fed mới Kevin Warsh thực sự làm những gì ông nói, van đó sẽ được xiết lại đúng lúc hai cột kia đang mục.

Cả ba không tự nhiên lung lay. Chúng bị lung lay bởi chính con sóng AI mà mọi người đang kỳ vọng sẽ cứu vớt thị trường. Và ngay cả trong kịch bản lạc quan nhất, con đường đến phồn thịnh đi qua thất nghiệp hàng loạt của chính những người đang mua cổ phiếu thụ động mỗi tháng.

Phép tính đơn giản chumba đưa ra: một nhân viên văn phòng lương 100.000 đô, cộng phúc lợi, tổng chi phí với công ty vào khoảng 150.000 đô/năm. Giá trị hiện tại của chuỗi thanh toán đó kéo dài 10 năm là hơn 1 triệu đô. Mỗi lần công ty không tuyển người đó nữa, phần giá trị đó cộng ngược về vốn chủ sở hữu. Không phải lý thuyết — đây là cơ học kế toán.

Cái hash collision của toàn bộ thị trường là đây: mọi người đang nhìn vào AI và kéo ra pattern dot-com boom — công nghệ lên, nền kinh tế lên, tất cả cùng hưởng lợi. Nhưng dot-com không phá vỡ mô hình tuyển dụng của Fortune 500. Lần này thì có.

Các ngành khác đang sống bằng cache nào?

Y tế. Một bác sĩ chẩn đoán hình ảnh mất trung bình 8–15 năm đào tạo để xây dựng bộ nhớ về pattern: thế này là khối u lành, thế kia cần sinh thiết ngay. Cái bộ nhớ đó là sức mạnh của họ — cho đến khi AI như Google MedGemini hay Viz.ai được cập nhật liên tục trên hàng triệu ca mà không một bác sĩ đơn lẻ nào có thể tiếp cận. Lookup table của máy giờ mới hơn của người. Thẩm quyền vẫn còn đó. Gate của ngành thì không.

Pháp lý. Khi Harvey AI hay các công cụ tương tự có thể rà soát hàng ngàn vụ án tiền lệ nhanh hơn bất kỳ luật sư junior nào, cái gì còn lại phía sau mức phí 800 đô/giờ? Vẫn là chữ ký, quan hệ, và uy tín tổ chức. Nhưng khi khách hàng nhận ra họ đang trả giá đó để một luật sư junior dùng AI làm bài rồi senior partner review 15 phút — Gate của sự tin tưởng đó sẽ không giữ được mãi.

Bán lẻ, ngành mình gần hơn. Lợi thế của các chuỗi lớn — Walmart, 7-Eleven, WinMart — từng đến từ việc biết khi nào cần đặt hàng gì, ở đâu, với lượng bao nhiêu. Kinh nghiệm vận hành tích lũy nhiều năm. Nhưng hệ thống dự báo nhu cầu dựa trên AI giờ đọc thời tiết, scan mạng xã hội, theo dõi traffic, kết nối dữ liệu thanh toán — lookup table của nó lớn hơn và mới hơn bất cứ team merchandising nào. Nguy hiểm không phải là người ta không biết AI tồn tại. Ai cũng biết. Vấn đề là Gate của họ không hoạt động — nhận ra pattern mới, rồi vẫn kéo ra cách làm năm 2019 vì “đây là cách chúng ta vẫn làm.”

Người chọn ở lại

Kết phim Project Hail Mary — và đây là phần mình nghĩ nhiều nhất sau khi ra khỏi rạp — Grace tìm ra cách cứu cả Trái Đất lẫn hành tinh của Rocky. Ông có thể về. Tàu cứu nạn đã ở trong tầm với. Loài người đang chờ.

Ông chọn ở lại.

Không phải vì ông không yêu loài người. Mà vì ông đã suy luận ra một điều mà không chỗ nào của nền văn minh Trái Đất có thể chứa được: giá trị của ông, ở thời điểm đó, không nằm ở việc trở về. Nằm ở việc tiếp tục ở cạnh Rocky — sinh vật duy nhất có thể làm những gì ông không thể, và cần ông làm những gì Rocky không thể.

Gate của Grace hoạt động đúng như thiết kế — nhưng không phải vì ông dũng cảm hay cao thượng. Đơn giản hơn: ông không có cache để bảo vệ. Ông hỏi “trở về để làm gì?” mà không bị bộ nhớ cũ cắt ngang câu trả lời. Và kết luận ông đến được là: giá trị của mình, ở thời điểm này, không nằm trên hành tinh đó.

Đây là điều nền văn minh Trái Đất không thể suy luận ra — không phải vì thiếu thông minh, mà vì cache “sống sót và trở về” đã ăn sâu đến mức không ai nhận ra đó là một lựa chọn, chứ không phải một chân lý.

Nghịch lý của bộ phim là thế này: người mất trí nhớ nhiều nhất lại là người tư duy sạch nhất. Không phải vì trí nhớ là xấu — mà vì không có cache nào bị overload, Gate của ông không có gì để phải lọc ngoài thực tế trước mắt.

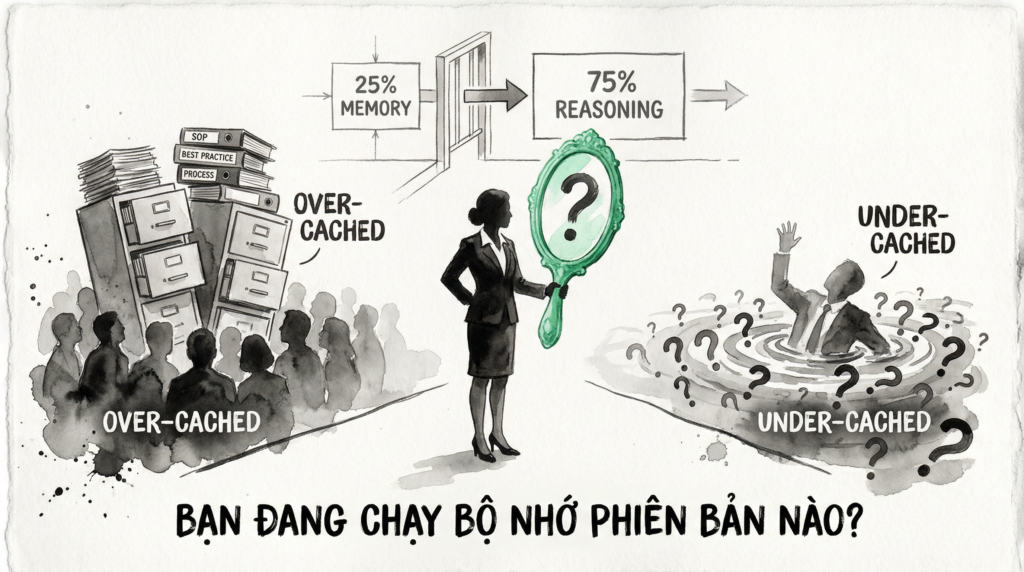

Bạn đang chạy bộ nhớ phiên bản nào?

25% bộ nhớ, 75% suy luận. Và cái Gate. Điều mà DeepSeek đã chỉ cho chúng ta.

Đây không phải công thức cho cuộc sống. Nhưng là một câu hỏi đáng tự hỏi.

Những người under-cached xử lý mỗi email như quyết định triết học. Họ kiệt sức triền miên vì không có gì được tự động hóa, không có gì được phép trở thành habit. Những người over-cached thì nói bằng buzzword, có câu trả lời trước khi nghe xong câu hỏi — và điều họ gọi là “kinh nghiệm” thực ra là một bộ sưu tập pattern đang dần lỗi thời áp vào bối cảnh không còn phù hợp.

Gate không mặc định hoạt động. Nó cần được bật chủ động. Nó cần bối cảnh thách thức, người xung quanh đủ dũng cảm để nói “Ông đang nhớ sai rồi,” và tổ chức đủ trưởng thành để không trừng phạt ai dám cập nhật lookup table của mình.

Hầu hết tổ chức không xây Gate. Họ xây thêm bộ nhớ — thêm quy trình, thêm best practice, thêm SOP — và gọi đó là trưởng thành.

Trong tổ chức của bạn, ai đang vận hành Gate?

Không phải câu hỏi về công nghệ. Là câu hỏi về quyền lực: ai được phép nói “pattern này không còn khớp nữa” — và tổ chức đó có đủ khả năng nghe không, hay sẽ kéo ra một lý do cũ hơn để bác bỏ?

Grace không có cache để bảo vệ. Nên ông tự do để chọn đúng.

Còn bạn thì đang bảo vệ cái gì?